每天驱动 OpenClaw,Token 点数烧得比想象中快太多了! 为什么这么费钱? 因为 OpenClaw 的每一次消息交互,都会把完整的对话历史原封不动地发给模型。随着会话越来越长,上下文 token 消耗呈指数级上涨,一天下来几百上千请求很常见,免费额度根本撑不住,付费也心疼。

痛定思痛,我下定决心:必须找到真正能用的免费替代方案。

于是我疯狂对比各种模型、供应商、配置方式,反复在 OpenClaw 上实测稳定性、tool calling 表现、上下文保持能力和实际任务完成度。

最终,我筛选出了 5 个目前能在 OpenClaw 上稳定跑起来的免费(或接近免费)模型: 有的完全本地跑,零 token 成本; 有的利用官方免费云额度,日常用量绰绰有余; 有的甚至便宜到几乎可以忽略不计。

如果你也正在被Token费用劝退,或者单纯想把 AI agent 的使用成本降到接近 0,这篇很可能帮你省下一笔不小的钱。

这篇文章把我的 5 个常用模型、为什么选它们、以及在 OpenClaw 里的具体配置方法全部拆解给你。

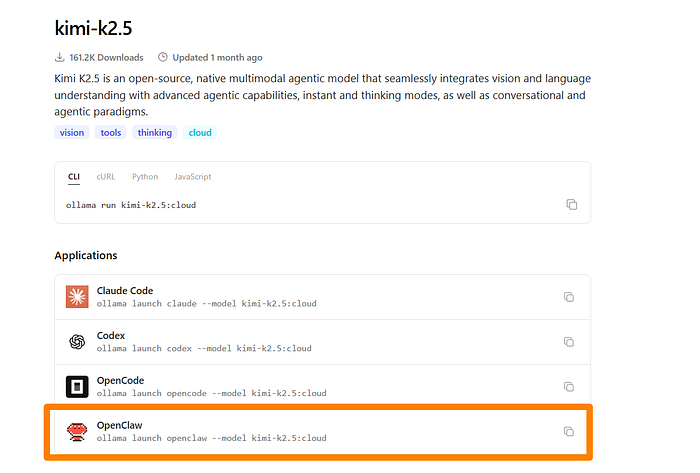

Kimi K2.5(目前最受欢迎的免费云模型)

Moonshot AI 的 Kimi K2.5 是 OpenRouter 上当下最火的免费模型。 我本来只是把它当临时备用,结果一用就成了我的主力模型。

优点:

推理质量接近 Claude Sonnet 支持 tool calling 128K 上下文窗口,能轻松 hold 住 OpenClaw 的长对话,不会丢前面内容 特别适合读邮件、管理日历、跑自动化的 agent

Moonshot 官方宣布平台永久免费开放。 在 OpenRouter 上,免费额度大概是每分钟 20 次请求,每天重置。

配置方法:

openclaw config set agents.defaults.model.primary "openrouter/moonshotai/kimi-k2.5"如果你用 Ollama,还有更快的办法:Kimi K2.5 支持云模型直连,一条命令搞定:

ollama launch openclaw --model kimi-k2.5:cloud最佳场景:通用 agent 工作、写代码、研究、内容起草。

强烈推荐新手从这个模型开始,免费云推理最省心。

局限:免费额度有速率限制,超级重度使用时会限额。

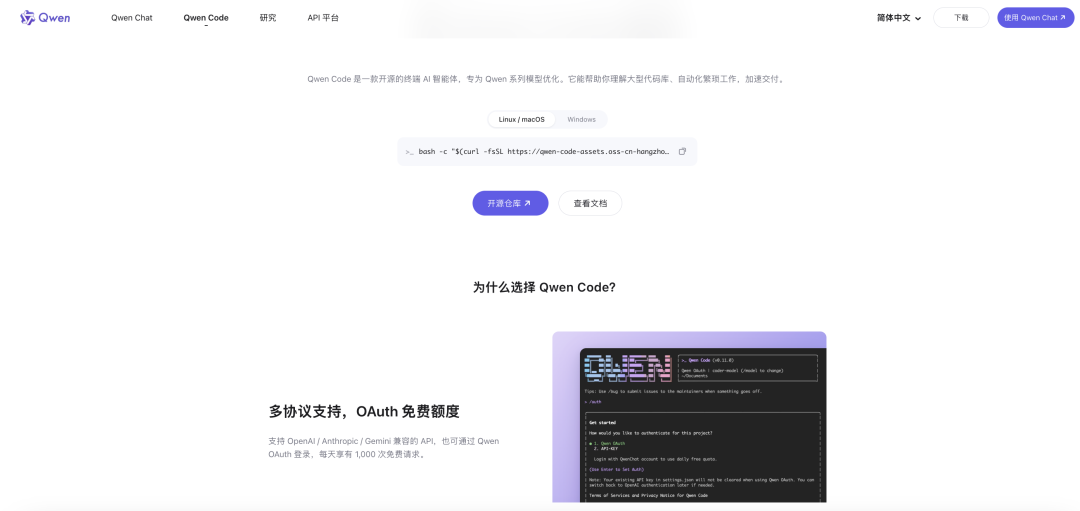

Qwen 通过 OAuth 授权

很多人找免费 OpenClaw 模型时会直接跳过 Qwen,但其实它很香。

OpenClaw 内置了 Qwen 的 OAuth 插件 一次设备码授权,就能拿到 Qwen Coder 和 Qwen Vision 模型,每天 2000 次免费请求 Qwen 3.5 天生带 agent 能力:会思考、搜索、用工具、写代码 网站:https://qwen.ai/qwencode

配置步骤:

openclaw plugins enable qwen-portal-authopenclaw models auth login --provider qwen-portal --set-default

登录后,模型引用方式变成 qwen-portal/coder-model 或 qwen-portal/vision-model。 token 会自动刷新,不用反复登录。

适合个人用,不建议整个团队压上去。但日常写代码、读文件、自动化,2000 次/天完全够。

最佳场景:编程任务、视觉相关工作流,想要稳定免费额度又不想管一堆 API key 的人。

局限:OAuth token 过期或被收回时,需要重新跑登录命令。

Gemini Flash

如果你想要大上下文窗口又不想花钱,Google 的 Gemini Flash 是目前最好的免费云选项。

免费额度:每分钟 15 次请求,最高支持 100 万 token 上下文 对 OpenClaw 这种容易变长的会话,上下文长度是巨大优势 网站:https://deepmind.google/models/gemini/flash/

我把它当备用模型:Kimi K2.5 限额时,Gemini 接力。

配置方式(编辑 config 文件):

{"models": {"providers": {"google": {"models": [{ "id": "gemini-3-flash", "name": "Gemini 3 Flash" }]}}}}

需要去 Google AI Studio 生成一个 GEMINI_API_KEY,免费的,两分钟搞定。

最佳场景:超长对话、文档总结、研究任务,当主力模型撞限额时的可靠后备。

局限:Google 免费 tier 可能会用你的数据训练模型。个人 side project 和学习没问题,涉及私有代码或客户敏感数据建议用付费版或本地跑。

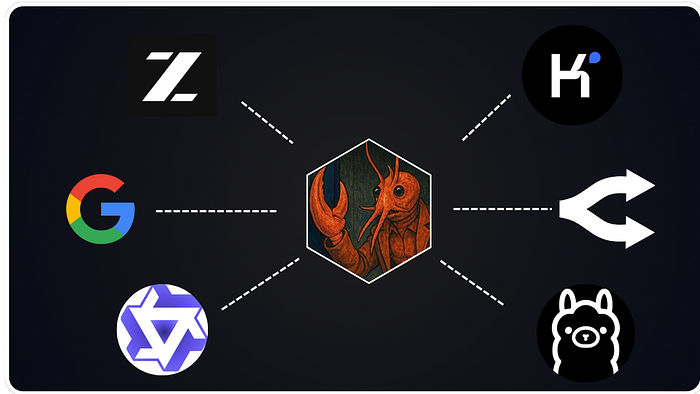

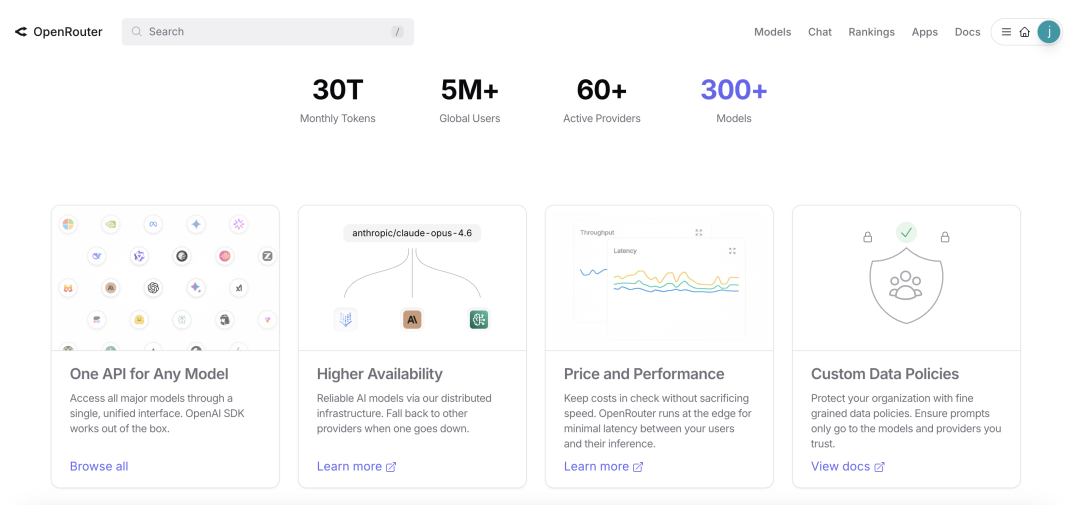

OpenRouter 的免费模型池

OpenRouter 不是单个模型,而是一个模型网关,通过一个 API key 就能访问几十家供应商的模型。

最爽的是加 :free 后缀,就能零成本跑支持的模型。 免费模型池会轮换,但通常都有不错的选择。

网站:https://openrouter.ai/models?q=free

我一般这样配:Kimi K2.5 做主力,Llama 模型做第一个 fallback,Gemini 做最后保底。

基础免费配置示例:

{"agents": {"defaults": {"model": {"primary": "openrouter/meta-llama/llama-3.2-3b-instruct:free"}}}}

OpenClaw 还内置了扫描工具,能自动检测当前 OpenRouter 上哪些免费模型可用,并测试 tool calling 和图片支持:

openclaw models scan这个命令会按能力排行,让你交互式选主力 + fallback,省得手动一个个试。

最佳场景:想要最大灵活性、自动切换免费模型的用户;也适合喜欢尝鲜不同模型的人。

局限:免费模型今天有明天可能没了,要定期检查和更新 fallback。

Qwen 3.5 本地跑(Ollama)

前面四个都依赖别人服务器,这个是彻底本地:通过 Ollama 跑 Qwen 3.5。

阿里专门为 agent 工作流打造的模型 tool calling、多步推理、代码生成能力在同级别开源模型里顶尖 9B 版本 16GB 内存的现代笔记本就能跑,27B 需要 32GB+ 但效果更好 M 系列 Mac 或有独显的机器体验特别丝滑

Ollama 最近加了一键启动 OpenClaw 的功能:

ollama launch openclaw --model qwen3.5一条命令拉模型、配置 provider、连 OpenClaw,超级方便。 当然你也可以手动装 Ollama,ollama pull qwen3.5,再自己配 provider。

最佳场景:极致隐私、完全离线、敏感数据不想上云、想把成本压到接近 0 的开发者。

局限:需要好点的硬件。9B 版 16GB 内存能跑,但复杂多步任务会吃力。

最终配置推荐

折腾几周后,我现在稳定用这个组合:

- 主力

Kimi K2.5 —— 日常任务免费搞定 - Fallback 1

本地 Qwen 3.5(Ollama)—— 撞限额时接管 - Fallback 2

Gemini Flash —— 大上下文,适合重度使用

彻底告别付费模型了,免费方案已经足够强。

如果你也在用这些模型玩 OpenClaw,欢迎留言分享你的配置和体验~