一、看完这篇文章你将获得什么?

用20分钟,亲手搭建:

- 强劲性能:2核CPU + 16GB内存 + 8TB存储的”白嫖级”VPS

- 完整记忆:利用Dataset实现对话历史持久化,增量备份重启恢复

你只需要提供模型API就可以永久使用。

二、准备工作

必备账号

- Hugging Face账号(免费注册)→ 点击注册

- AI模型账号(需要付费)→ Kimi2.5:https://platform.moonshot.cn/ 或者GLM-4.7:https://www.bigmodel.cn/glm-coding?ic=IORXTLCLVM 或者硅基流动一定免费额度的众多模型:https://cloud.siliconflow.cn/i/kQTQzfuz

三、部署指南

步骤1:激活2核16G VPS配置

操作流程:

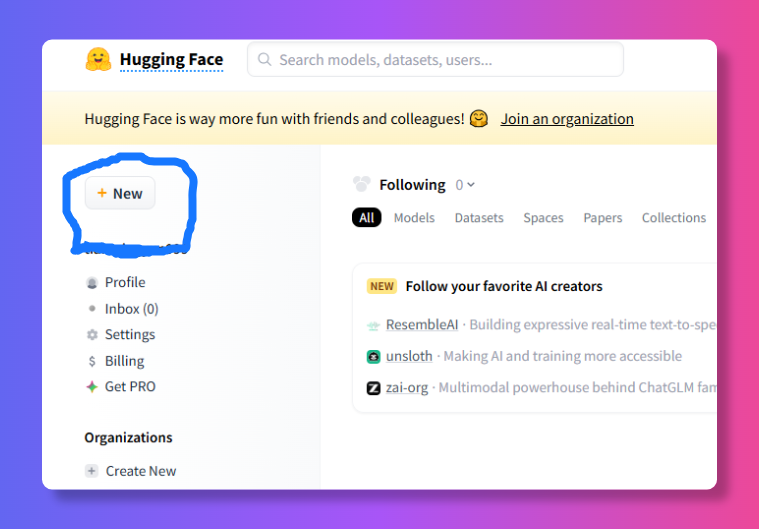

- 点击最左侧的 “new”,然后选择 “Space”

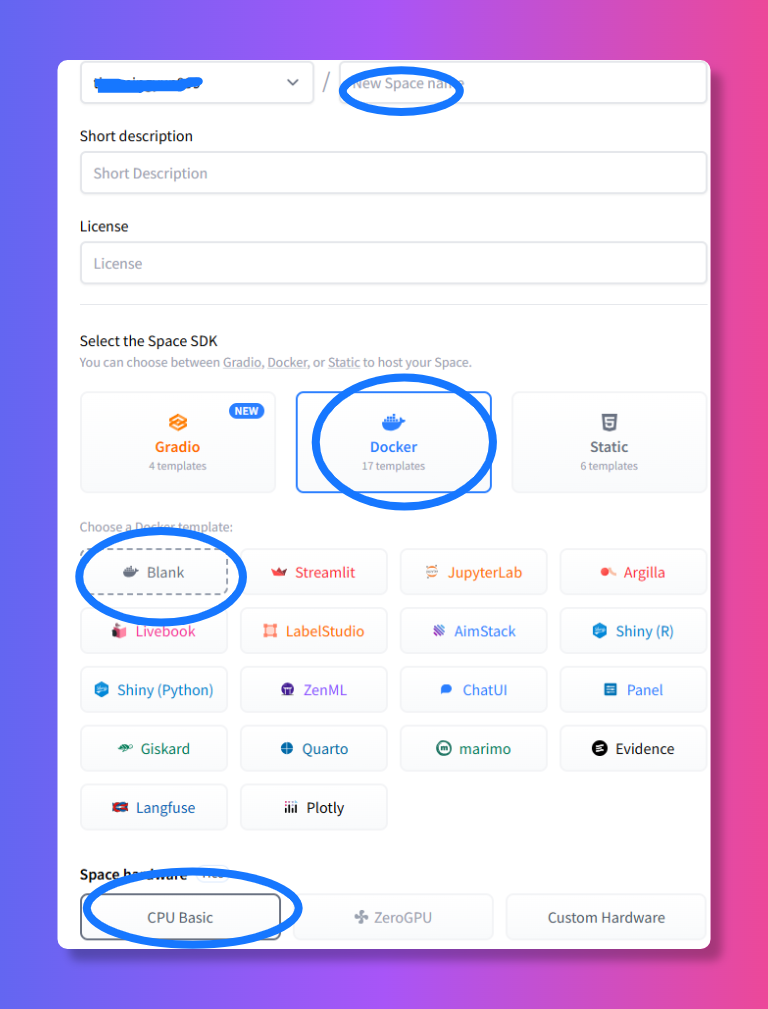

- 配置选项: SDK: Docker Visibility: Public 硬件:选择默认 CPU方案

- 空间命名:yourname-openclaw-ai(英文)

注意事项:

- 必须选Docker而非Gradio/Streamlit

步骤2:创建参数和Dataset

B. 创建Dataset:

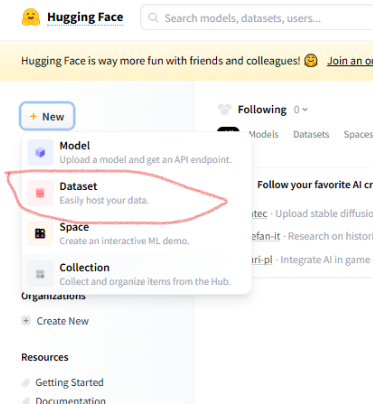

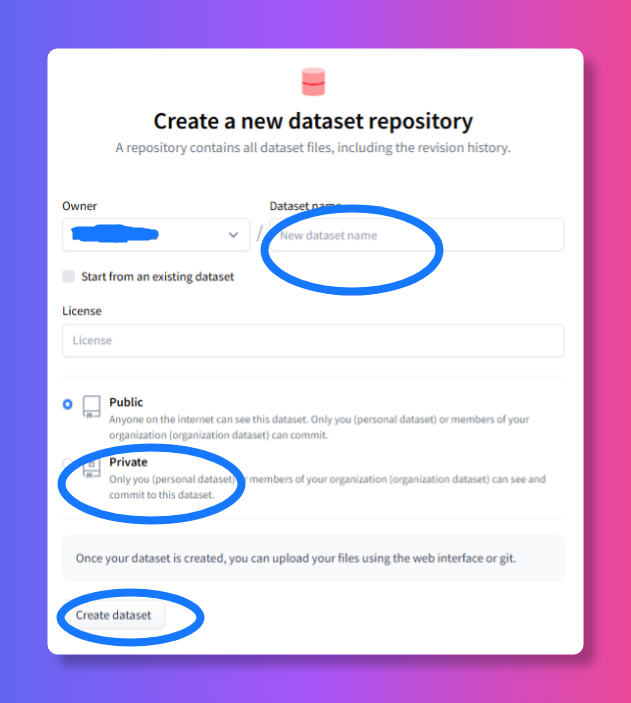

- 登录 huggingface.co → “新建” → “New dataset”

注意记录Dateset的名称。

A. 创建HF Token:

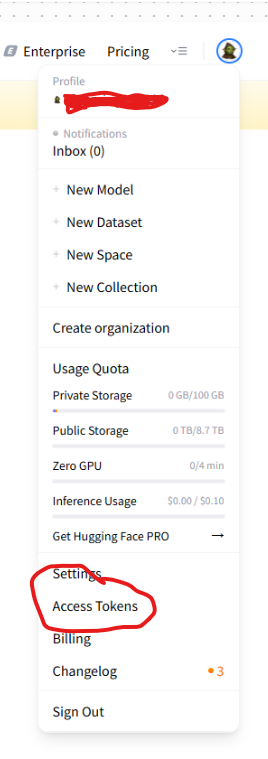

- 登录 huggingface.co →点击自己的头像,选择最下面的 → “Access Tokens” → 验证自己的登录口令

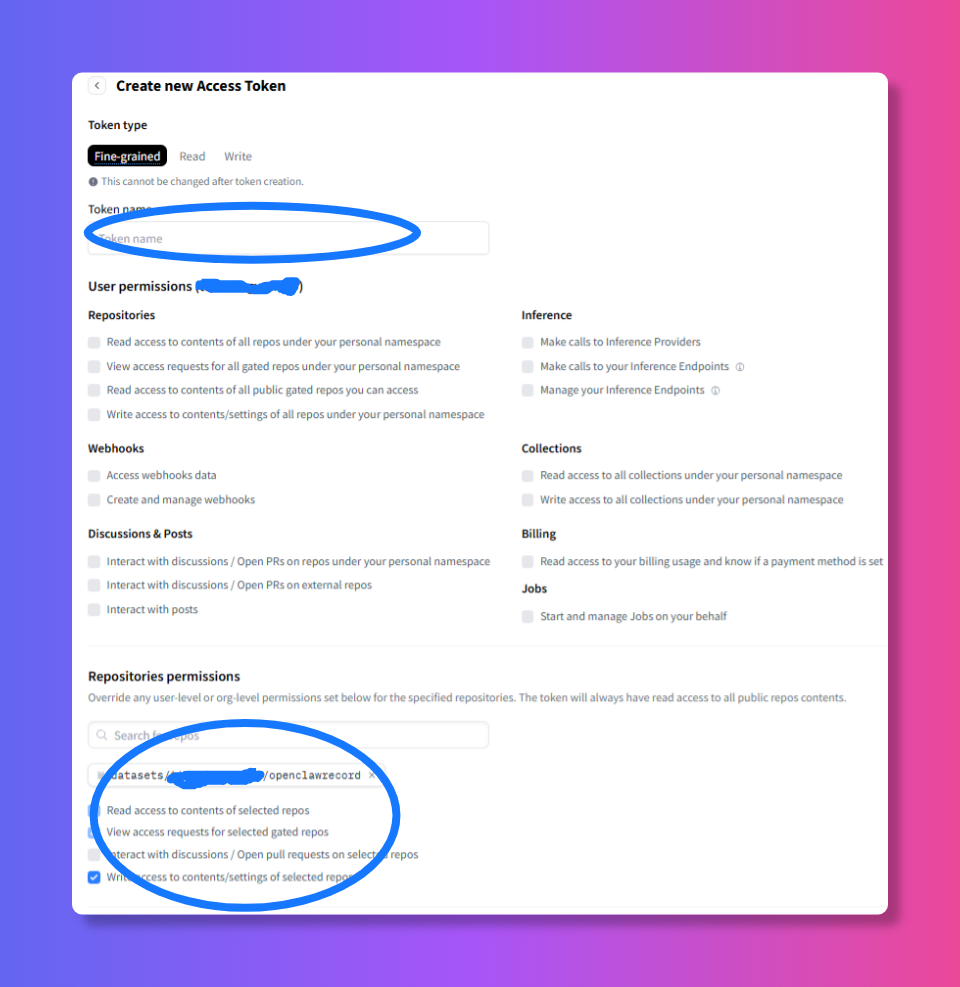

- 点击 **”Create New Token”: 填写Token名称 在下面的输入框中点击会展示自己已经创建的dataset,选择对应的dataset,选择 “Write access to contents/settings of selected repos” 权限 最后点击页面最下面的 “Create New Token”*。 打开的页面中复制Token,保存到安全的位置,用于一会在环境变量中填写。注意这个Token只展示一次。

步骤3:添加环境变量

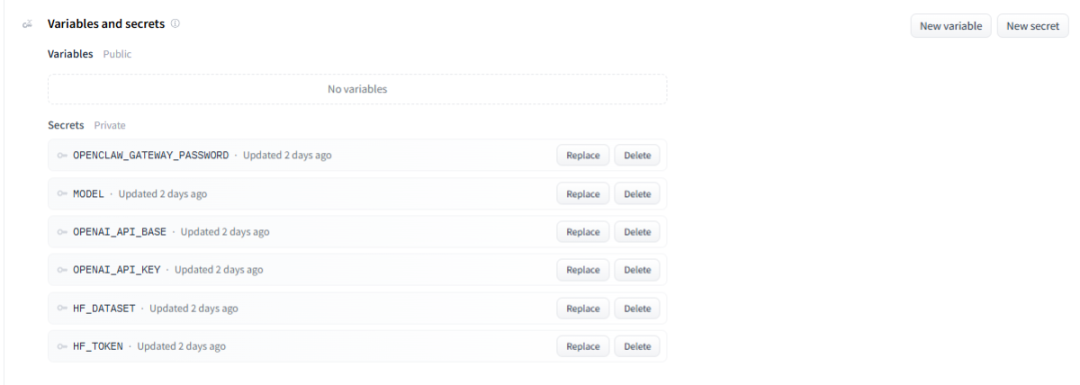

**A. 进入Space空间页面 → “Settings” B. 下拉页面找到 “Variables and secrets”,点击 “New Secret” 逐个创建下面所有变量:

| 变量名 | 必填 | 权限类型 | 作用描述 |

|---|

OPENCLAW_GATEWAY_PASSWORD | | | |

OPENAI_API_KEY | | Secret | |

OPENAI_API_BASE | | | |

MODEL | | | 模型 ID(如 deepseek-ai/DeepSeek-V3.2)。 |

HF_TOKEN | | Secret | |

HF_DATASET | | | |

步骤4:部署OpenClaw框架

**A. 启动Docker容器

- 点击 “Add file” → “Create a new file”

# 核心镜像:Node 22 slim 保证了环境的现代性与轻量化

FROM node:22-slim

# 1. 安装系统依赖

# 包含:git (拉取依赖), openssh-client (解决构建报错), build-essential/g++/make (编译原生模块), python3 (运行同步脚本)

RUN apt-get update && apt-get install -y --no-install-recommends

git openssh-client build-essential python3 python3-pip

g++ make ca-certificates

&& rm -rf /var/lib/apt/lists/*

# 2. 安装 Hugging Face 命令行工具

RUN pip3 install --no-cache-dir huggingface_hub --break-system-packages

# 3. 构建环境优化

# 修复 Git 证书问题并将所有 SSH 协议重定向为 HTTPS

RUN update-ca-certificates &&

git config --global http.sslVerify false &&

git config --global url."https://github.com/".insteadOf ssh://git@github.com/

# 4. 全局安装 OpenClaw

RUN npm install -g openclaw@latest --unsafe-perm

# 5. 设置环境变量

ENV PORT=7860

OPENCLAW_GATEWAY_MODE=local

HOME=/root

# 6. 核心同步引擎 (sync.py)

# 针对 OpenClaw 新版 MEMORY.md 机制进行了全路径覆盖

RUN echo 'import os, sys, tarfilen

from huggingface_hub import HfApi, hf_hub_downloadn

from datetime import datetime, timedeltan

api = HfApi()n

repo_id = os.getenv("HF_DATASET")n

token = os.getenv("HF_TOKEN")n

n

def restore():n

try:n

print(f"--- [SYNC] 启动恢复流程, 目标仓库: {repo_id} ---")n

if not repo_id or not token: n

print("--- [SYNC] 跳过恢复: 未配置 HF_DATASET 或 HF_TOKEN ---")n

return Falsen

files = api.list_repo_files(repo_id=repo_id, repo_type="dataset", token=token)n

now = datetime.now()n

for i in range(5):n

day = (now - timedelta(days=i)).strftime("%Y-%m-%d")n

name = f"backup_{day}.tar.gz"n

if name in files:n

print(f"--- [SYNC] 发现备份文件: {name}, 正在下载... ---")n

path = hf_hub_download(repo_id=repo_id, filename=name, repo_type="dataset", token=token)n

with tarfile.open(path, "r:gz") as tar: tar.extractall(path="/root/.openclaw/")n

print(f"--- [SYNC] 恢复成功! 数据已覆盖至 /root/.openclaw/ ---")n

return Truen

print("--- [SYNC] 未找到最近 5 天的备份包 ---")n

except Exception as e: print(f"--- [SYNC] 恢复异常: {e} ---")n

n

def backup():n

try:n

day = datetime.now().strftime("%Y-%m-%d")n

name = f"backup_{day}.tar.gz"n

print(f"--- [SYNC] 正在执行全量备份: {name} ---")n

with tarfile.open(name, "w:gz") as tar:n

# 路径说明:sessions(网关历史), workspace(记忆文件), agents(配置), memory(旧版目录)n

for target in ["sessions", "workspace", "agents", "memory", "openclaw.json"]:n

full_path = f"/root/.openclaw/{target}"n

if os.path.exists(full_path):n

tar.add(full_path, arcname=target)n

api.upload_file(path_or_fileobj=name, path_in_repo=name, repo_id=repo_id, repo_type="dataset", token=token)n

print(f"--- [SYNC] 备份上传成功! ---")n

except Exception as e: print(f"--- [SYNC] 备份失败: {e} ---")n

n

if __name__ == "__main__":n

if len(sys.argv) > 1 and sys.argv[1] == "backup": backup()n

else: restore()' > /usr/local/bin/sync.py

# 7. 容器入口脚本 (start-openclaw)

# 负责恢复数据 -> 生成配置 -> 启动网关 -> 定时备份

RUN echo "#!/bin/bashn

set -en

mkdir -p /root/.openclaw/sessionsn

mkdir -p /root/.openclaw/workspacen

n

# 启动前执行数据恢复n

python3 /usr/local/bin/sync.py restoren

n

# 清理 API Base 地址n

CLEAN_BASE=$(echo "$OPENAI_API_BASE" | sed "s|/chat/completions||g" | sed "s|/v1/|/v1|g" | sed "s|/v1$|/v1|g")n

n

# 生成 openclaw.json 配置文件n

cat > /root/.openclaw/openclaw.json <<EOFn

{n

"models": {n

"providers": {n

"siliconflow": {n

"baseUrl": "$CLEAN_BASE",n

"apiKey": "$OPENAI_API_KEY",n

"api": "openai-completions",n

"models": [{ "id": "$MODEL", "name": "DeepSeek", "contextWindow": 128000 }]n

}n

}n

},n

"agents": { "defaults": { "model": { "primary": "siliconflow/$MODEL" } } },n

"gateway": {n

"mode": "local", "bind": "lan", "port": $PORT,n

"trustedProxies": ["0.0.0.0/0", "10.0.0.0/8", "172.16.0.0/12", "192.168.0.0/16"],n

"auth": { "mode": "token", "token": "$OPENCLAW_GATEWAY_PASSWORD" },n

"controlUi": { "allowInsecureAuth": true }n

}n

}n

EOFn

n

# 启动定时备份进程 (每 3 小时执行一次,增强安全性)n

(while true; do sleep 10800; python3 /usr/local/bin/sync.py backup; done) &n

n

# 启动 OpenClaw 网关n

openclaw doctor --fixn

exec openclaw gateway run --port $PORTn

" > /usr/local/bin/start-openclaw && chmod +x /usr/local/bin/start-openclaw

EXPOSE 7860

CMD ["/usr/local/bin/start-openclaw"]

- 点击 “Commit” 提交。如果复制有无,也可以在这里直接下载Dockerfile文件:「Dockerfile」启动前自动恢复 和 运行中定时备份版,链接:https://pan.quark.cn/s/87986adedc05

部署验证:

**B. 查看部署日志与调试方法

部署过程中,日志是你唯一的“眼睛”。通过日志可以判断系统是在编译、恢复数据还是遭遇报错。

- 查看位置:在 Space 页面顶部,点击 Logs 选项卡。

- 关键日志点解析: Build 阶段日志: 出现大量 CC 或 node-gyp 字符:正常。这是在编译 C++ 插件,耗时较长(3-8 分钟)。 出现 Successfully built:镜像构建成功。 **Runtime 阶段日志 (Container Logs)**: Restoring backup_…:说明同步脚本正在从你的 Dataset 拉取历史记录。 Browser control service ready:关键标志。看到这一行代表 Agent 的核心驱动已就绪。 listening on ws://0.0.0.0:7860:代表网关已上线,可以尝试打开页面。 unauthorized / pairing required:如果你没带 Token 访问,这里会刷屏报错,属于正常现象。

四、 数据持久化深度解析

上面Dockerfile中存在一些数据持久化机制,这里解释以下实现机制。

1. 如何避免Space 未被访问导致休眠?

由于Hugging Face会休眠48小时没人访问的space,因此建议使用提供计划任务的平台执行cron计划,周期性访问Hugging Face Space的主页。比如:https://www.cron-job.org/

- 创建计划任务:填写自己的space的主页,比如:https://name-aienzouzhe.hf.space。设定合适的时间,选择每天3点执行。建议添加实现每天两次。

2. Space 重启会导致哪些数据丢失?

Hugging Face Spaces 使用的是容器快照技术,每次重启都会回到“出厂设置”。

- 丢弃的数据:在 /root/.openclaw/sessions 下产生的所有新对话记录、所有在 Web UI 里临时修改的设置、浏览器插件产生的 Cookie 和任务进度。

3. 哪些数据会持久存储?

- 代码层:你写在 Dockerfile 里的代码和启动脚本。

- 配置层:通过脚本硬编码生成的 openclaw.json。

- 备份包:已经成功通过脚本上传到 Dataset 里的 .tar.gz 压缩包。

4. 为什么要采用“Dataset 备份恢复机制”?

我们没有采用传统的数据库或付费存储,而是选择了 Dataset 方案,主要为了解决以下问题:

- 成本规避:Hugging Face 的 Persistent Storage(持久化硬盘)通常是按量计费且需要绑定信用卡。Dataset 存储是完全免费的。

- 冷启动恢复:解决了 Space 闲置自动关机后“失忆”的问题。

- 多端同步:你可以把这个 Dataset 挂载到任何地方,实现记录的跨平台迁移。

- 安全性:通过 Dataset 的 Private 属性,确保只有你自己能访问这些敏感数据。