之前买的kimi coding plan 又限流了,先用免费模型顶一顶。

推荐两家,nvidia 和 opencode zen

opencode zen 在openclaw里面原生支持,只需要在模型配置里面输入api key就可以了

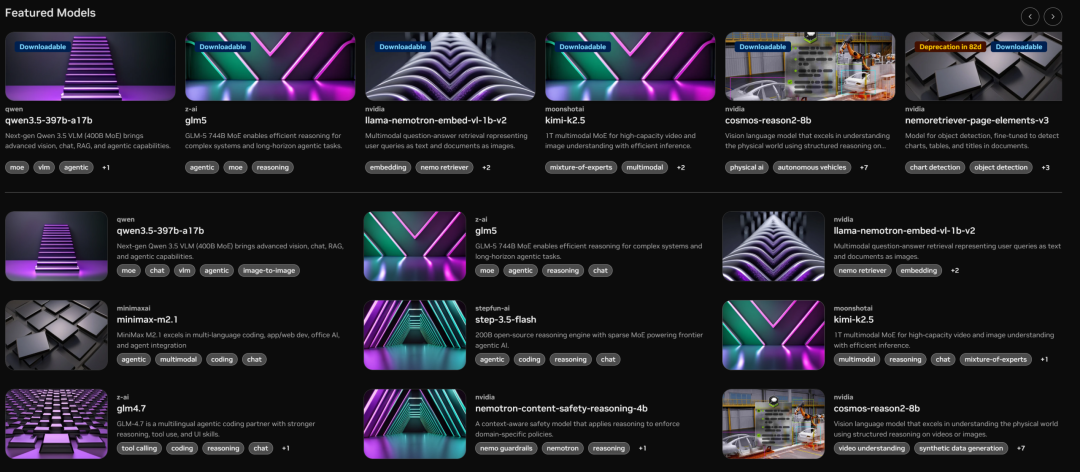

nvidia 为了宣传自家的GPU基础设施,提供对当前主流开源模型的支持, 比如千问的 qwen3.5-397b-a17b, 智谱的 glm-5, kimi 的 kimi-k2.5,minimax 的 minimax-m2.1.

官方宣称最高40rpm,实际测试虽然可能没有这么高,但是它免费,模型选择多,并且限速之后等一会就又可以用了,作为免费api可以说是最优选择。比那些groq之流只提供一年前的老旧小模型比要好多了。

Nvidia api 接入

首先要申请api key:

• 访问 https://build.nvidia.com/models 注册登录 • 右上角头像点击-选择 api keys – 点击 Generate API Key创建• 拷贝API key 备用

写入openclaw的配置文件

配置文件一般在 ~/.openclaw/openclaw.json, 在该文件里面加入一下models配置,

"models": {

"mode": "merge",

"providers": {

"nvidia": {

"baseUrl": "https://integrate.api.nvidia.com/v1",

"apiKey": "${NVIDIA_API_KEY}",

"api": "openai-completions",

"models": [

{ "id": "moonshotai/kimi-k2.5", "name": "Kimi K2.5" ,

"reasoning": true,

"input": [

"text",

"image"

]

},

{ "id": "minimaxai/minimax-m2.1", "name": "Minimax M2.1" ,

"reasoning": true,

"input": [

"text",

"image"

]

}

]

}

}

}同时记得在agents.defaults.model.primary 改为你想使用的模型,比如 “nvidia/moonshotai/kimi-k2.5″,参考下图:

这里多说一下模型配置参数的含义。models 里面主要看providers这个结构,它定义了不同的模型提供者,比如这里我们写的是nvidia。每一个provider下面可以定义很多个模型,通过id来索引。所以如果逆向添加nvidia的其它模型,就可以按照这个格式来加入。同理如果是其它api的提供者,那就在 “nvidia” 这个层级下加一个类似结构。而agents.defaults.model.primary里面写入”nvidia/moonshotai/kimi-k2.5″就代表使用nvidia下的moonshotai/kimi-k2.5模型。

另外 apiKey 这里 你可以直接把上述的key直接贴入。或者更模块化的方式是在 ~/.openclaw 下面新建一个.env文件,以变量形式写入:

# .env 文件内容

NVIDIA_API_KEY=your_api_key_here以上配置完成重启gateway就可以了,一般情况更改完openclaw.json会自动重启,如果没有就手动重启

openclaw gateway restart

阿里云百炼 Coding Plan 接入

如果你觉得Nvidia的免费API不够用,或者需要更稳定的调用体验,阿里云百炼的Coding Plan是个不错的补充方案。

之前我写过一篇阿里云部署OpenClaw的教程 阿里云部署OpenClaw:79元/年搭24小时AI代理,算是和云部署闭环了。现在阿里云又推出了Coding Plan活动,Lite基础套餐首月仅需7.9元(原价40元/月),包含18000次调用,性价比很高。

Lite版本最多18000次请求,Pro版本90000次。套餐内不仅有千问系列模型,还支持GLM-5、Kimi K2.5等第三方模型。

不过需要注意,这是首月优惠价。模型更新迭代快,建议按月购买,避免被绑定。

链接在这里:https://cn.aliyun.com/benefit/scene/codingplan?from_alibabacloud=&userCode=bu3b1wdt

阿里云的套餐和nvidia的模型接入类似,两个都没有openclaw的官方接入点,只能通过openai兼容接口接入, 可以参考以上nvidia接入的方式,在配置文件内修改models参数如下:

(注意,如果要保留nvidia接口,注意不要删除nvidia的配置参数)

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "YOUR_API_KEY",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

}apikey 和 修改agents.defaults.model.primary跟nvidia的类似,想用哪个模型就把agents.defaults.model.primary改成 对应{provider}/{id}的形式。

总结

Nvidia API和阿里云百炼Coding Plan该如何选择?

Nvidia免费API的优势:

• 完全免费,无需付费 • 模型丰富,支持Qwen3.5、GLM-5、Kimi K2.5、MiniMax M2.1等主流模型 • 适合轻度使用和临时应急

阿里云百炼Coding Plan的优势:

• 稳定可靠,7.9元/月起 • 调用次数充足(Lite 18000次/月,Pro 90000次/月) • 首月费用低,性价比突出

推荐策略: 两者可以同时配置,Nvidia作为日常主力,阿里云作为备选方案。在openclaw中可以通过切换primary模型灵活切换,非常方便。这样即使一边限流,另一边也能顶上,再也不用忍受漫长的等待了。

openclaw 部署系列文章: