很多 AI Coding 项目都在比谁更像“更强的程序员”。但 Open SWE 真正值得看的地方,不在它能多写几行代码,而在它开始认真回答一个团队问题:如果你真想在组织里部署一个编程 Agent,它该怎么接进现有研发流程?

我一开始以为它只是 LangChain 又发了个 agent demo。真去读完 README、安装文档和 agent/server.py 之后,判断变了:它更像是在开源一套“内部 coding agent”的标准骨架。

项目名:Open SWE

GitHub:https://github.com/langchain-ai/open-swe[1]

增长信号:GitHub 7.2k+ Star,来自 LangChain 团队,最近 30 天还在持续更新

一句话判断:它不是给个人开发者再造一个聊天框,而是在开源“团队级编码 Agent”的落地架构。

Open SWE 的官方定位很直接:给你的组织构建 internal coding agent 的开源框架。

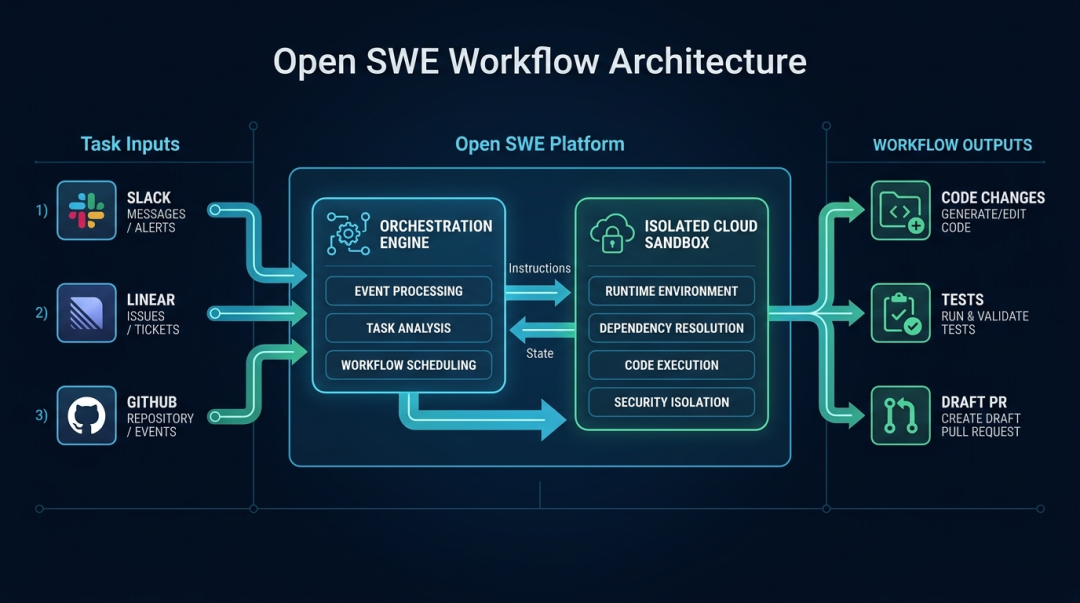

重点不在 “agent”,而在 “internal”。它默认面向的是团队协作场景:任务从 Slack、Linear、GitHub 这些入口触发,Agent 进入隔离沙箱拿代码、跑命令、改文件,最后自动提交并开 Draft PR。仓库首页和博客反复强调的,也是这条路线:把 Stripe、Ramp、Coinbase 这类团队已经验证过的内部 Agent 模式,做成一套可 fork、可改造的底座。

示意图:Open SWE 更像一条工程工作流——任务从 Slack、Linear、GitHub 进入,在隔离沙箱里执行,最后回到代码变更与 Draft PR。

1)它切中的不是“模型更强”,而是“组织里怎么用”

真正拉开差距的经常不是模型本身,而是这些问题:从哪里触发、一开始给多少上下文、在什么边界里执行、结果怎么回到团队工作流。

Open SWE 把这些都当成了一等问题来设计。比如它默认给每个任务分配独立云沙箱。README 和 CUSTOMIZATION.md 都写得很清楚:任务在隔离环境里跑,仓库克隆进去,Agent 在里面拿完整权限执行;如果沙箱断连,还会重建。这个思路我比较认同,因为团队里先要解决的不是“让 Agent 少点确认框”,而是先把爆炸半径关进边界里。

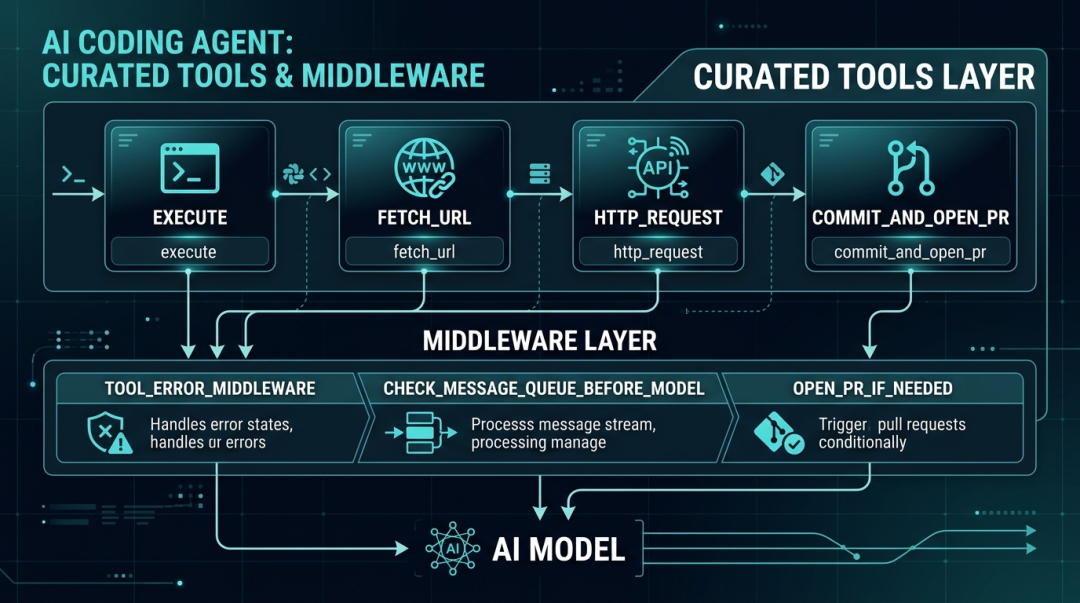

2)它的工具设计很克制

README 里列出来的核心自定义工具其实不多:fetch_url、http_request、commit_and_open_pr、linear_comment、slack_thread_reply,再加上 Deep Agents 自带的文件读写、搜索、子任务拆分。

这反而是我愿意高看它一眼的地方。很多 Agent 项目容易掉进“工具越多越强”的幻觉,但进入工程场景后,工具越多,稳定性和可预测性往往越差。Open SWE 明显是在走“少而精”的路子:先把最短闭环打通,再谈组织级扩展。

示意图:Open SWE 更强调可维护的工具集和确定性中间件,而不是无限堆工具。

3)它把上下文工程做成了默认配置

Open SWE 这里做了两层:如果代码仓根目录有 AGENTS.md,系统会把它读进 prompt;如果任务来自 Linear、Slack、GitHub,就把 issue、线程或 PR 评论上下文一起带进去。

这件事不花哨,但很关键。很多编码 Agent 出问题,不是不会写,而是开工前对问题理解太薄。Open SWE 至少是在尽量让 Agent 从“像团队成员那样接任务”的位置开始,而不是从一个空 prompt 开始猜。

Open SWE 真正像工程系统的地方,我觉得有两个。

一个是子 Agent。它底层基于 Deep Agents,而 Deep Agents 原生支持通过 task 工具拆子任务。主 Agent 可以把不同子问题并行分发给子 Agent,再把结果汇总回来。越往复杂任务走,这种拆分能力越重要。

另一个是中间件。Open SWE 在 agent/server.py 里把 ToolErrorMiddleware、check_message_queue_before_model、ensure_no_empty_msg、open_pr_if_needed 直接放进主执行链。这里最有代表性的就是 open_pr_if_needed:如果 Agent 干完活却没自己开 PR,系统会在后面兜底,把关键动作补上。

该交给模型判断的步骤,交给模型;不该拿稳定性交给模型碰运气的关键动作,就用确定性机制兜住。很多 Agent 产品后面不稳,问题不全是模型不够强,而是把所有重要步骤都交给模型即兴发挥了。

如果你真想判断它适不适合自己,不用一上来就搞全套生产部署。我会更建议先走一条最短闭环:

先确认你是不是目标用户。 如果你本来就在用 Slack / Linear / GitHub 协作,又想让 Agent 贴着现有流程工作,那 Open SWE 很对路;如果你只是想在本地补代码、问问仓库,Cursor、Claude Code、Codex CLI 往往更直接。

再按官方链路搭起来。 INSTALLATION.md 给的依赖很清楚:Python 3.11–3.13、uv、LangGraph CLI、ngrok。安装流程也不复杂:

git clone https://github.com/langchain-ai/open-swe.git

cd open-swe

uv venv

source .venv/bin/activate

uv sync --all-extras

uv run langgraph dev --no-browser

真正麻烦的部分不是装依赖,而是 GitHub App、LangSmith、Webhook 这些接入配置。这也说明它不是“下载即用”的个人玩具,而是按“团队接入型系统”来设计的。

最后挑一个低风险任务验证闭环。 先试修一个非核心 bug、补一段测试、处理一条简单 review comment,重点不是看它能不能惊艳,而是看这条链顺不顺:

任务触发 → Agent 理解上下文 → 沙箱执行 → 修改代码 → 跑验证 → 开 PR → 在线程里回报

这条链如果能稳定通,你再去接内部工具、接自定义中间件,才有意义。

适合:想做内部编码 Agent 的工程团队;不想从零拼 Agent 架构的人;对权限边界、沙箱隔离、自动 PR 有要求的团队。

不太适合:只想找本地 coding copilot 的个人开发者;想零配置上手的人;组织流程本身还没想清楚的团队。

如果只用一句话概括 Open SWE,我会这么说:

它不是又造了一个编程 Agent,而是把“团队级 Coding Agent”该怎么长,第一次比较完整地开源了出来。

这件事的意义,比“它眼下是不是最强模型驱动”要大得多。因为接下来能真正留在工程团队里的,很可能不是最会写代码的那个 Agent,而是最会接流程、最会吃上下文、最会在边界内稳定干活的那一类系统。

如果你在看企业内部 Agent、研发自动化、Slack / Linear / GitHub 里的 AI 执行层,这个仓库值得认真翻;如果你只是想找个本地写代码更顺手的助手,它就没必要排到第一优先级。

如果这篇对你有用,建议点个关注。我会持续把 GitHub 上值得用的 AI 工具拆成「最短上手闭环 + 坑点清单 + 可复用配置」,让你少走弯路。

引用链接

[1]https://github.com/langchain-ai/open-swe