AutoResearchClaw

“ 一个开源的端到端自主科研系统,它接收用户输入的一个研究想法,通过 23 个精密编排的自动化阶段——涵盖文献检索、知识综合、假设生成、实验设计、代码生成、沙箱执行、结果分析、论文撰写与同行评审——最终输出可直接投稿至 NeurIPS、ICML、ICLR 等顶级会议的完整学术论文。整个过程无需人工干预,系统具备自修复、自决策、自学习能力,并能与 OpenClaw、MetaClaw 等生态工具深度集成,真正实现”聊一个想法,出一篇论文”的科研自动化愿景。

Github地址

https://github.com/aiming-lab/AutoResearchClaw

核心功能特性

全链路自主科研流水线

AutoResearchClaw 将传统科研 workflow 拆解为 8 个阶段组、23 个精细阶段。从最初的研究主题分解,到多源文献的智能采集与筛选,再到知识提取与综合,系统通过结构化的多智能体辩论生成可验证的研究假设。实验设计阶段会根据自动检测到的硬件环境——无论是 NVIDIA CUDA 显卡、Apple MPS 还是纯 CPU 配置——生成硬件感知的可执行代码,并在隔离沙箱中运行,具备 NaN/Inf 检测、运行时错误自愈、迭代优化等能力。当实验结果返回后,系统进入关键的决策循环:自主判断是继续推进、调参优化,还是彻底转向新的研究方向,所有中间产物都会自动版本化管理。

真实可信的学术基础设施

幻觉引用是 AI 科研工具的核心痛点,AutoResearchClaw 构建了四层引用核查机制:arXiv ID 校验、CrossRef/DataCite DOI 验证、Semantic Scholar 标题匹配,以及最终的大语言模型相关性评分。文献来源覆盖 OpenAlex、Semantic Scholar 和 arXiv 三大数据库,配合查询扩展与三态熔断器设计,确保即使在部分服务不可用的情况下仍能优雅降级。生成的 BibTeX 文件会自动精简至与正文引用严格一致,杜绝虚假文献。

顶会级论文生成与质量保障

写作阶段采用分段生成策略,控制篇幅在 5000 至 6500 词之间,内置反数据捏造守卫和反免责声明强制机制。系统原生支持 NeurIPS 2025、ICLR 2026、ICML 2026 等顶会 LaTeX 模板,自动处理数学公式、表格、图片与交叉引用。三轮质量门控阶段可配置为人工审批或自动通过,配合多智能体同行评审机制——包含方法论与证据一致性检查——确保最终输出的学术严谨性。

生态集成与扩展能力

作为 OpenClaw 兼容服务,用户可通过自然语言对话直接触发完整科研流程:”帮我研究 X”,其余工作由 OpenClaw 自动完成克隆、安装、配置与执行。系统同时支持 ACP(Agent Client Protocol),可调用 Claude Code、Codex CLI、Kimi CLI 等任意兼容的编码智能体作为 LLM 后端,无需 API 密钥。对于复杂实验,OpenCode Beast Mode 可自动路由至多文件项目生成,包含自定义架构与完整训练循环。

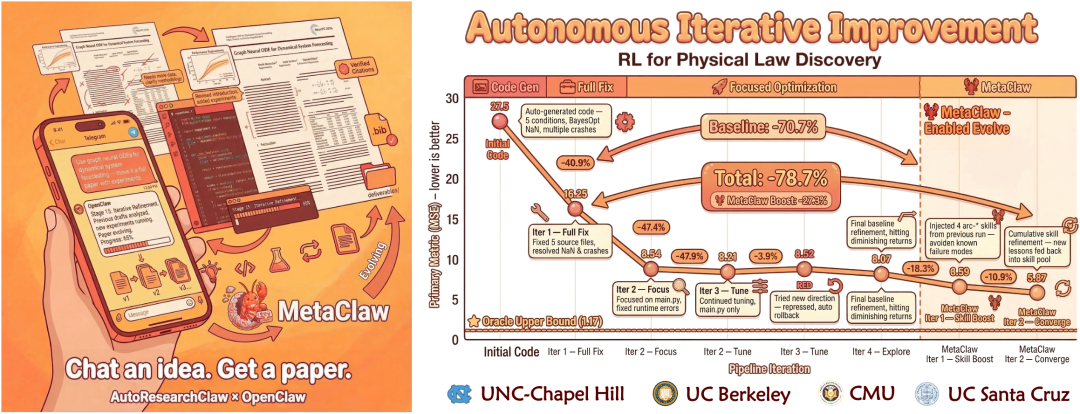

持续进化与跨运行学习

通过可选的 MetaClaw 集成,流水线能够从每次运行中提取结构化教训,自动转化为可复用技能并注入后续所有 23 个阶段。对照实验显示,启用后阶段重试率降低 24.8%,优化循环次数减少 40%,整体鲁棒性提升 18.3%。所有技能文件以 Markdown 格式存储,用户可随时审阅系统学到的经验。

部署与使用方式

快速启动:一行命令入门

最简洁的入门路径只需依次执行四条命令:

# 克隆仓库并安装

git clone https://github.com/aiming-lab/AutoResearchClaw.git

cd AutoResearchClaw

python3 -m venv .venv && source .venv/bin/activate

pip install -e .

# 交互式初始化:自动检查 Docker、LaTeX,可选安装 OpenCode Beast Mode

researchclaw setup

# 配置 LLM 提供商与 API 密钥

researchclaw init

# 运行完整流水线

export OPENAI_API_KEY="sk-..."

researchclaw run --config config.arc.yaml --topic "Your research idea" --auto-approve

执行完成后,所有产物集中于 artifacts/rc-YYYYMMDD-HHMMSS-<hash>/deliverables/ 目录,包含可编译的 LaTeX 源文件、BibTeX 引用库、实验代码、图表数据与多智能体评审报告,可直接上传 Overleaf 或本地编译。

最小必要配置

核心配置仅需定义项目标识、研究主题与 LLM 接入点:

project:

name:"my-research"

research:

topic:"Your research topic here"

llm:

base_url:"https://api.openai.com/v1"

api_key_env:"OPENAI_API_KEY"

primary_model:"gpt-4o"

fallback_models: ["gpt-4o-mini"]

experiment:

mode:"sandbox"

sandbox:

python_path:".venv/bin/python"

通过 OpenClaw 自然语言使用

已部署 OpenClaw 环境的用户,只需将 GitHub 仓库地址分享给 OpenClaw 智能体,随后用自然语言描述研究意图即可。OpenClaw 会自动读取 RESEARCHCLAW_AGENTS.md 理解流水线编排,完成环境准备与执行,最终返回论文与实验结果。这种模式下,用户完全无需接触命令行工具。

ACP 模式:调用本地编码智能体

配置文件中指定 provider: "acp" 并选择对应智能体命令,即可使用 Claude、Codex、Kimi 等工具的自有认证体系,绕过传统 API 密钥管理:

llm:

provider: "acp"

acp:

agent: "claude" # 或 codex、gemini、kimi 等

cwd: "."

高级配置与生产部署

完整配置体系支持多层级定制:实验模式可在模拟、沙箱、Docker 与远程 SSH 环境间切换;Docker 模式支持细粒度网络策略控制;通知通道可接入 Discord、Slack 实现进度推送;定时任务与跨会话记忆持久化满足自动化运维需求。所有配置项均向后兼容,核心流水线可在零外部依赖的情况下独立运行。